Tro det eller ej, men sommaren närmar sig. Och snart dricker vi ☕️, äter glass och lapar sol i vart och vartannat gathörn. Vad passar då bättre än att återintroducera "Glassmodellen för Generativ AI”, fast i en vidareutvecklad form. För visst känns glass mycket mer greppbart än tekniska termer som “Generative AI Stack” (även om det typ är det vi kommer att prata om den här veckan).

Oavsett hur intresserad du är av teknik så hoppas jag att glassen kan få dig att bättre greppa de olika komponenterna för Generativ AI. Och kanske också bättre förstå vilka olika aktörer som kan komma att tjäna AI-pengarna. Och varför de etablerade jättarna, aka BigTech, har stora 🍦-fördelar framåt.

Då kör vi!

/ Judith

Stack what?

Begreppet "stack" (typ stapel på svenska) är på teknikspråk kombinationer av mjukvara, hårdvara och annat tekniskt som gör att appar och digitala system funkar. Ofta illustrerat i form av olika lager som staplas på varandra – som i exemplet här under.

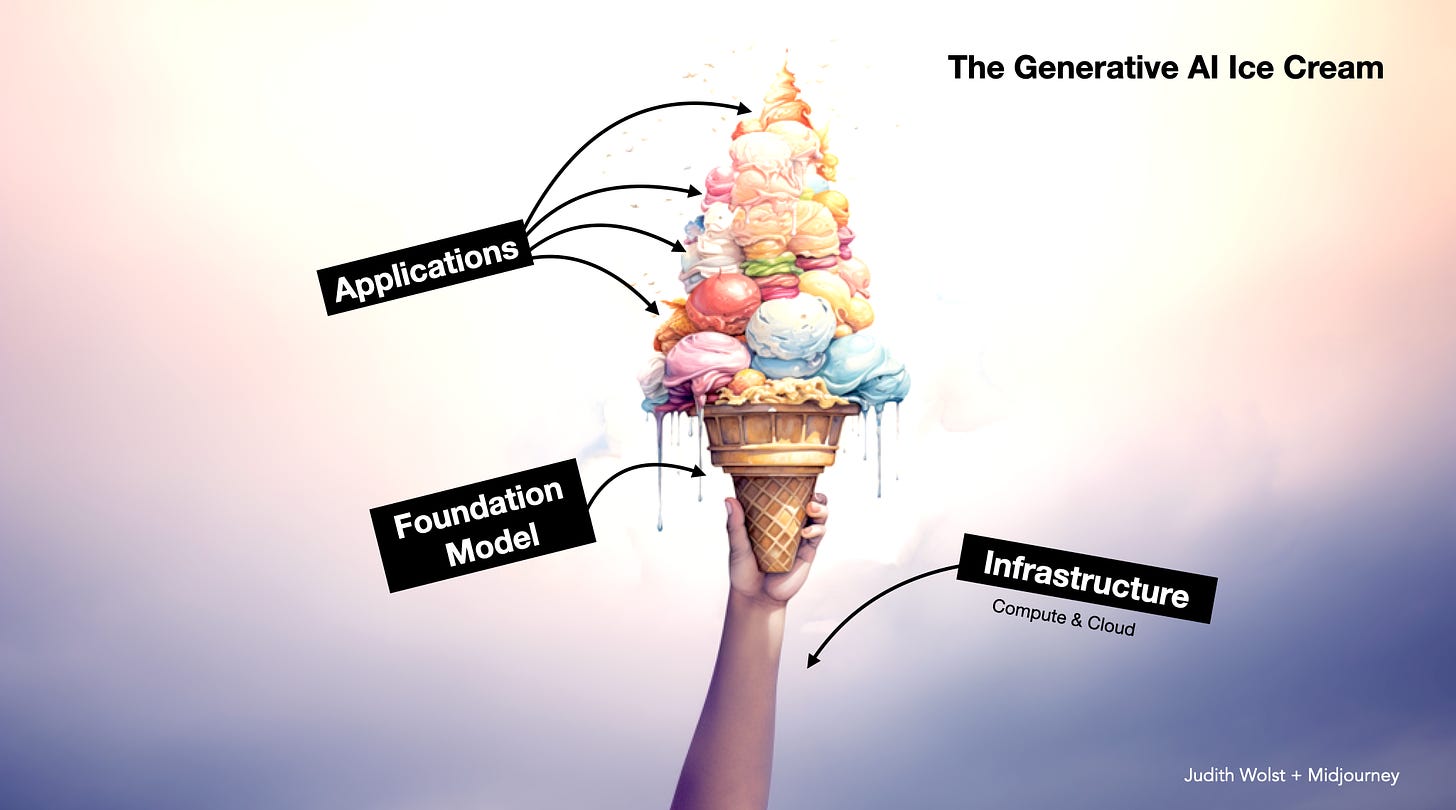

Eftersom alla inte verkar känna det där pirret i magen av klassiska stack-illustrationer knådade jag förra året om logiken till en glassmodell ⬇️.

Där visualiseringen såg ut så här:

Struten

I min glassmodell utgjordes AI-struten av all avancerad teknik som finns i så kallade “Foundation Models” (grundmodeller på svenska). I artikeln jag skrev då kan du läsa mer om Foundation Models, LLMs, Transformers och andra tekniska begrepp som finns i strutarna och som får dem att fungera.

Exempel på välkända grundmodeller (strutar) är GPT4 från ChatGPT och Gemini från Google DeepMind.

Glasskulorna

Glasskulorna då? Ja, de utgör allt spännande man kan bygga “ovanpå” grundmodellerna. Alltså själva applikationerna, eller “the application layer” som det ofta kallas för på stack-språk.

Här hittar vi allt det som du själv använder när du testar olika Generativa AI-tjänster. Min egen favorit är Perplexity.ai som är en toppenbra “research assistant” som hjälper mig när jag vill sätta mig in i nya områden. Perplexity har inte byggt någon egen strut, utan använder bland annat AI-modellerna GPT-4, Claude 3 och Mistral Large som grund (källa).

Låt oss nu lägga till ett nytt tredje lager i glassmodellen.

Säg hej till handen! 👋🏼

För att din glass inte ska falla mot marken och smälta bort likt spilld mjölk – ja då behöver du hålla hårt i din sötsak. På samma sätt som verklig glass behöver en stadig hand så behöver AI en massa stöttande teknisk infrastruktur.

Den uppdaterade glassmodellen ser därför ut så här ⬇️.

🖥️ Datorer och processorkraft (compute)

Dels behövs en massa datorer och processorkraft för att kunna bearbeta all den data som modellerna tränas på. Speciellt den typen av processorer som kallas för GPU:er (Graphics Processing Units) är extra vassa på att utföra beräkningar som krävs för att träna upp avancerade AI-modeller.

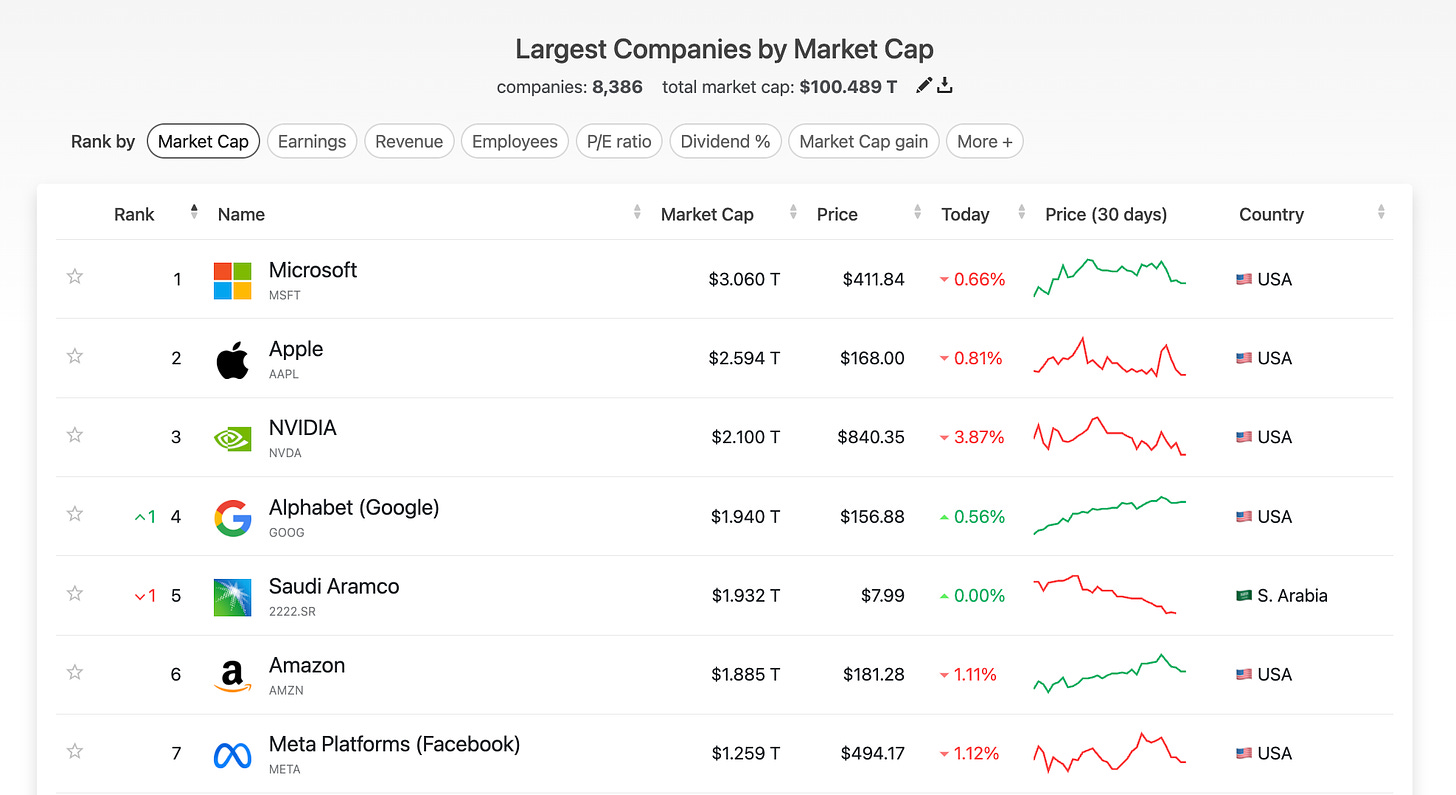

Exempel på GPU-tillverkare är NVIDIA som i rasande takt blivit världens tredje högst värderade bolag (by Market Cap).

☁️ Cloud

Även lagring i molnet blir superviktigt för att AI-modellerna ska ha någonstans att leva och verka.

Några av de största leverantörerna av molntjänster är AWS (Amazon Web Services), Microsoft Azure och Google Cloud.

Vem i glassmodellen tjänar då stålarna?

Om vi går tillbaks till de olika delarna i glassmodellen, vem kommer sannolikt att tjäna de stora pengarna framåt? Ja, det är frågan som väldigt många AI-utvecklare, entreprenörer, investerare, politiker, nyhetsbrevsförfattare och en rad andra funderar kring just nu. Sannolikt kommer alla delar i glassen kunna generera stora intäkter framåt;

De som utvecklar apparna som människor använder (glasskulorna)

De som utvecklar AI-modellerna (strutarna)

De som bidrar med all den tekniska infrastrukturen som också AI-behövs (handen)

Vem kan då bygga saker på de tre olika nivåerna?

1️⃣ Att utveckla glasskulorna (apparna) med hjälpa av AI, ja det kan vi alla göra genom att hämta själva intelligensen från redan framtagna strutar. Antingen kan vi betala för att använda stängda AI-modeller, så kallade proprietära modeller (exempelvis från OpenAI). Eller så kan vi använda modeller som är open source (exempelvis från Mistral). Här kan du läsa mer om skillnaden ➡️ De stängda vs de öppna AI-modellerna.

2️⃣ Att träna upp strutarna är betydligt svårare. Det kräver nämligen:

Jättemycket data (läs hela internet + lite till)

Jättemycket pengar (om man ska bygga något motsvarande ChatGPT, sådär 100 miljoner dollar och uppåt)

Många smarta AI-utvecklare och annan teknisk kompetens

Därför är det framför allt de redan etablerade techbolagen som ligger i täten när det kommer till att utveckla de vassaste grundmodellerna för Generativ AI.

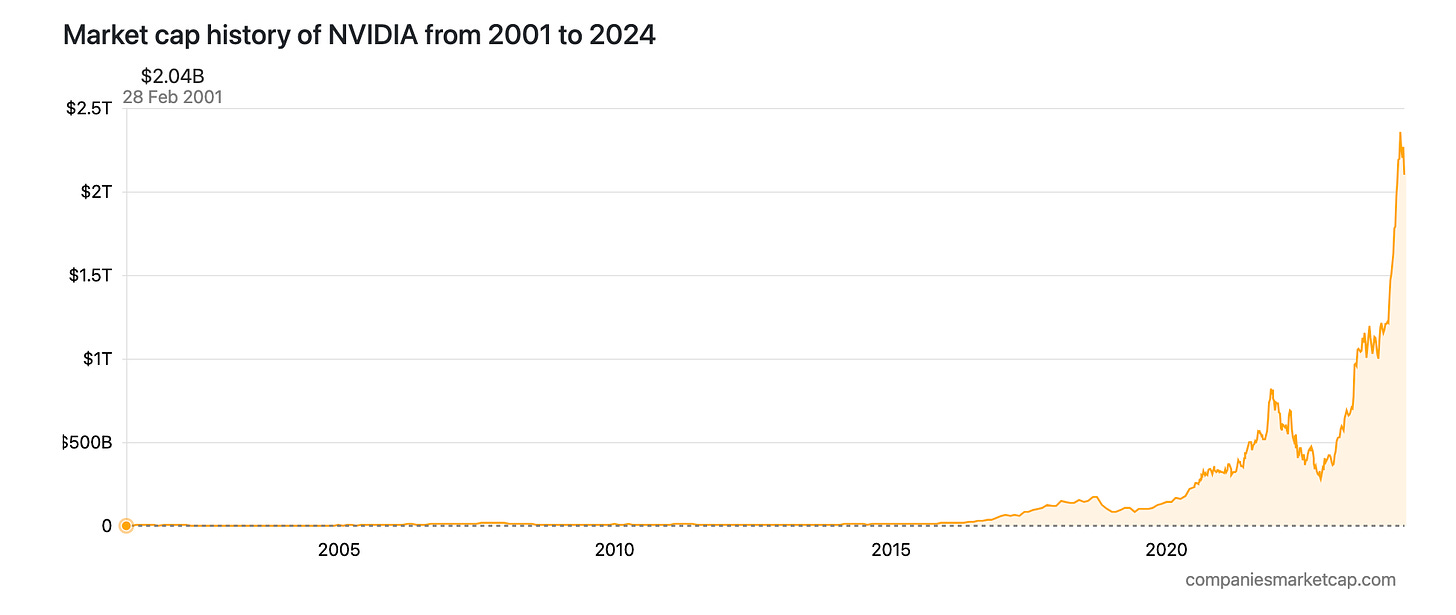

3️⃣ Infrastrukturen för AI då? Ja, den kommer från en massa olika bolag. En av dem som gjort en historisk tech-resa är NVIDIA, visualiserat i grafen här under.

Även bolag som Google, Amazon och Microsoft har tjänat jättemycket pengar på sina molnlösningar.

Flera BigTech-aktörer kontollerar glassens alla delar

Om vi tittar på glassen i sin helhet kan vi konstatera att vissa bolag jobbar i alla delarna av modellen. Och därmed kontrollerar den i sin helhet, handen inkluderat.

Om vi tar Google som ett exempel har bolaget flera Foundation Models. De har sin molnverksamhet Google Cloud. De har operativsystemet Android. Och de har egna glasskulor i form av gränssnitt mot användare, bland annat ChatGPT-utmanaren Gemini (själva grundmodellen/stuten har samma namn). Och! De har många andra gränssnittet som lär komma att AI-fieras framåt. Gränssnitt mot miljontals och åter miljontals användare; Google sök, G-mail, YouTube, Google Maps osv.

När man som Google äger alla delarna i glass-modellen, ja då är sannolikheten stor att man går ut som en av de verkliga AI-vinnarna. Förutom Google kan även bolag som Microsoft och Amazon läggas till hela-glassen-listan.

När nu de största och etablerad BigTech-spelarna fullt ut satsar på AI, ja då blir det svårare för alla andra att konkurrera. Speciellt för nystartade bolag som “bara” bygger glasskulor utifrån andras strutar.

Lått oss strukturera upp lite fler AI-fördelar som BigTech har.

Om man redan äger gränssnitten mot användare (som i exemplet Google ovan), ja då kan man “enkelt” koppla på AI till sina befintliga produkter. Exempelvis som Adobe har gjort med sitt Photoshop (se filmen här under). Och som Microsoft gör med sin Copilot (se film här). Nya AI-startups däremot, ja de måste börja från början. Och förtjäna sina användare, en efter en.

En annan stor fördel som BigTech har är deras pengar på banken som möjliggör för att subventionera nya AI-satsningar. Dumpa priset för det nya och låta etablerade affärsben finansiera. På samma sätt som Googles intäkter från sök har betalat för typ allt annat som bolaget också har utvecklat de senaste 20 åren. Nya aktörer, ja de måste ta betalt för sina lösningar för att kunna överleva och ha en chans att växa.

Den sista tydliga fördelen som BigTech har är att de sitter på ENORMA mängder data som behövs för att träna upp imponerande glasstrutar. Även om någon annan skulle vilja ge sig in för att utmana så är just tillgången till data något man inte kan trolla fram. Oavsett hur mycket pengar eller AI-talang man har. BigTech däremot har jobbat upp sina guldgruvor av data under många år.

Vad betyder då allt detta?

Som vanligt med framtiden har vi givetvis ingen aning om vilka som kommer att vinna AI-rejset. Dock kan vi konstatera att redan etablerade aktörer inom BigTech har stora 🍦-fördelar. Och att de fullt ut lär utnyttja de möjligheter som ges i att kontrollera alla tre lagren i modellen.

Där vinnarna har god chans att knipa åt sig ännu mer.

Det var allt för den här veckan.

Ta hand om er så hörs vi snart igen.

/ Judith

🥰 Tack för att du prenumererar på nyhetsbrevet Plötsligt i Framtiden! Om du har frågor eller tips på vad jag borde skriva om – kommentera gärna på LinkedIn eller skicka ett DM. & tipsa gärna andra som du tror skulle gilla att kika in i en framtid där teknik och hållbarhet är den gröna tråden.